文献阅读(5)

小样本图像分类研究综述

Survey of Few-Shot Image Classification Research

一、简介

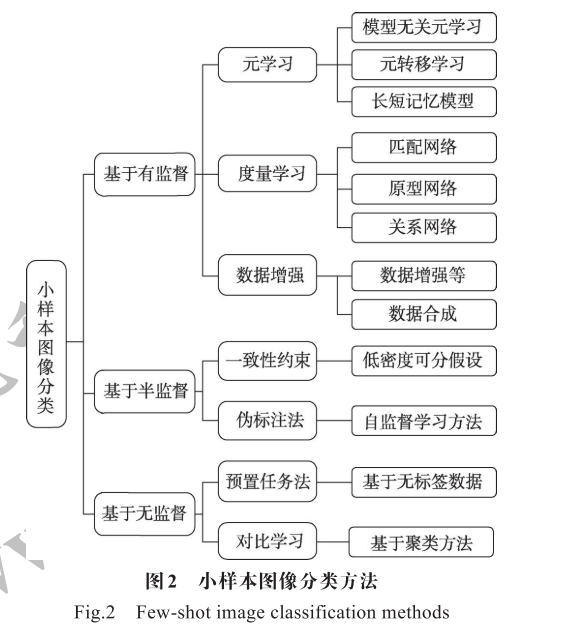

针对分类任务系统梳理了当前小样本图像分类的相关工作,小样本学习主要采用元学习、度量学习和数据增强等深度学习方法。从有监督、半监督和无监督等层次归纳总结了小样本图像分类的研究进展和典型技术模型,以及这些模型方法在若干公共数据集上的表现,并从机制、优势、局限性等方面进行了对比分析。最后,讨论了当前小样本图像分类面临的技术难点以及未来的发展趋势。(元学习, 度量学习)

二、文章的结构

综述文献感觉有点不一样,没有分级,直接接这说明小样本训练的总体结构:

1.小样的分类方法和数据集的介绍

提出三种小样本学习常用的方法(模型):

- 元学习:也叫做learn to learn, 简单的总结就是,不会直接去学习这个数据,而是会找一些相关的数据去学习,从未达到比较好的效果。(我的理解就是比较好的预训练)

- 度量学习:把小样本嵌入到不同“背景”之中去,来达到一个数据增强的效果 。

- 数据增强:生成对抗网络,或者简单的 裁剪、翻转、过滤、旋转和去噪,也就是GAN和transform

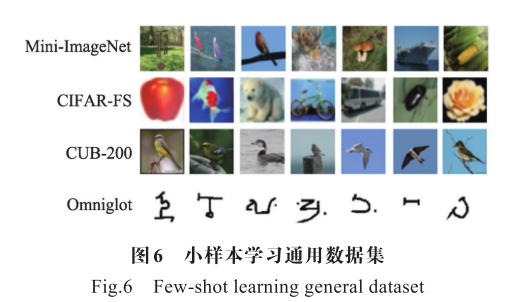

提出几种小样本数据集

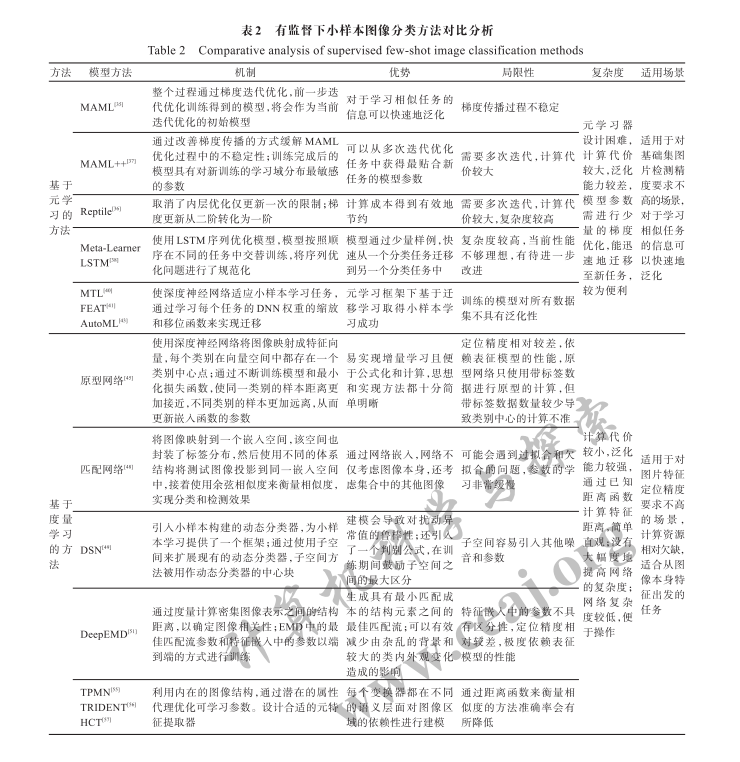

2、有监督方法的小样本数据分类的对比性分析

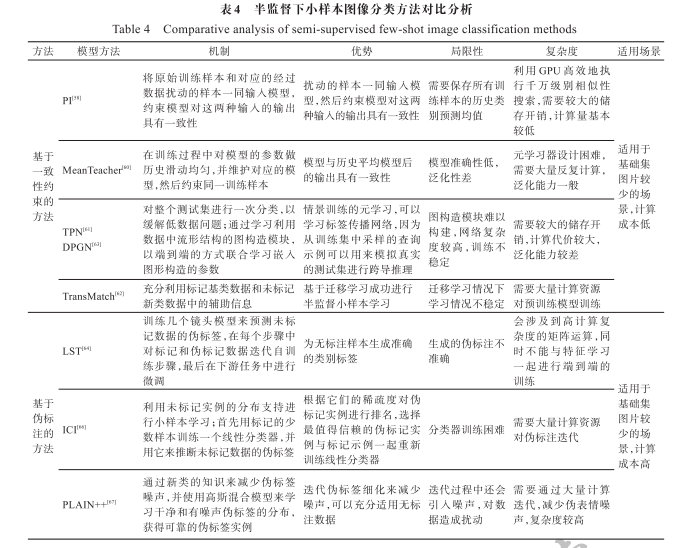

3、半监督方法的小样本分类对比分析

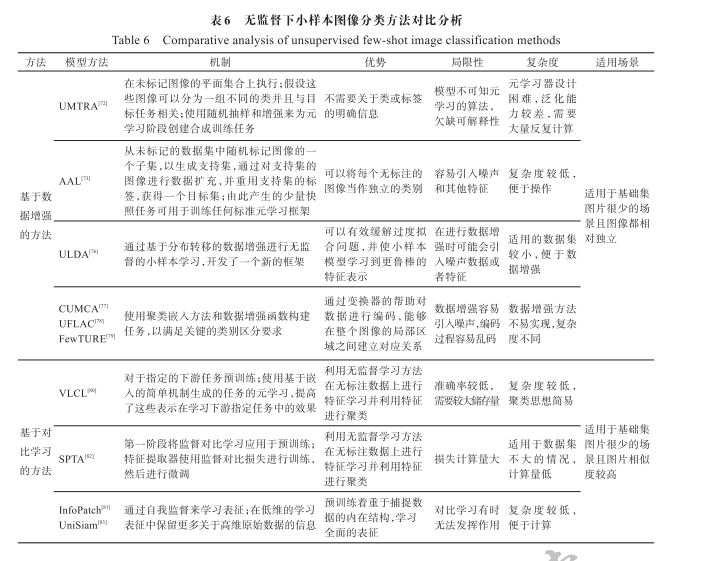

4、无监督方法的小样本分类对比分析

5、分析未来小样本数据分类的挑战

-

深度学习可解释性:

研究者无法得知神经网络模型到底学习了什么,也不知道每一个参数的具体含义是什么,因此无

法解释整个模型的运作机制,无法得出明确而有针对性的优化方案来解决问题,只能通过大量实验不

断地尝试提高性能的方法。因此一个好的可解释性工作对小样本甚至任何研究方向都有指导作用。 -

数据集挑战:

图像分类任务中目前仅有ImageNet作为预训练数据集,而文本分类中缺少类似的预训练数据

集,导致很多小样本图像分类方法缺少普适性,只适合在特定的数据集上发挥好的结果。在小样本图像

分类任务中Mini-ImageNet 和Omniglot 是两个被广泛使用的标准数据集,最近的斯坦福犬和CUB细

粒度分类等数据集也开始被人们用于测试,但并没有ImageNet数据集使用广泛。 -

模型预训练的挑战:

从本质上来看与小样本学习的定义背道而驰。从根本上解决小样本问题,就要做到不依赖预训练模型,需研究利用其他先验知识而非模型预训练的方法。

-

其他挑战:

将元学习与度量学习相结合,在进行特征提取之前,通过元学习预处理数据,设置更加合理的支持集

和查询集。虽然已经有研究者开始尝试,但是想实现这样的效果却十分困难,几个学习算法的相互结

合,有时候反而会导致小样本学习的性能下降。

6、小样本数据分类未来的发展方向

(1)在数据层面训练模型时尝试利用其他先验知识,或更好地利用无标注数据。

(2)对度量学习提出更有效的神经网络度量方法。

(3)元学习作为小样本学习的热点研究方向之一,元学习模型还继续有待提升。

(4)将对比学习与小样本学习有效地结合来达到更好的性能,是值得研究发展的方向。

(5)随着主动学习和强化学习框架的兴起,可以考虑将这些先进框架应用到小样本学习。

(6)通过Atention 来小样本数据分类的准确性

(7)尝试更多小样本数据学习方法的结合

三、总结

介绍了用于小样本学习的常用算法,以及小样本图像分类在有监督、半监督和无监督下的技

术发展;最后总结了小样本图像分类的挑战和未来发展方向。小样本学习领域目前仍然具有很多值得

研究者们去突破的方向。小样本学习在与常规学习相比较时,性能仍然存在一定的差距,因此还需要研

究者们继续探索。