文献阅读(4)

融合注意力机制和高效网络的糖尿病视网膜病变识别与分类

一、简介

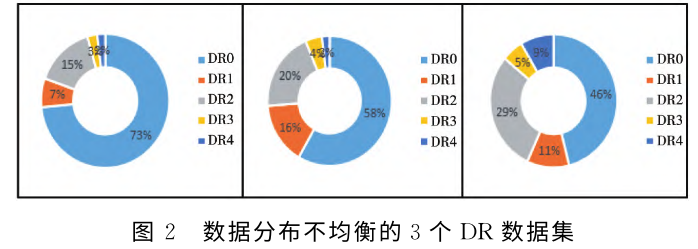

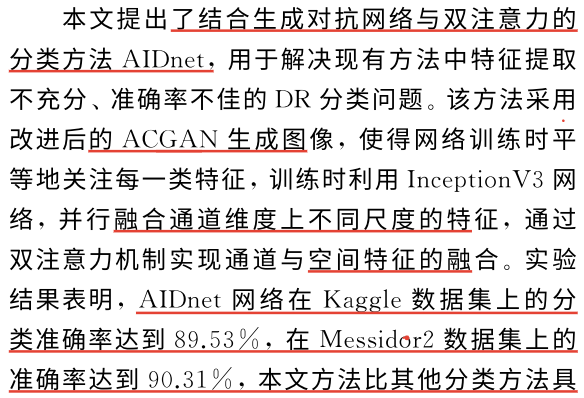

针对在糖尿病视网膜病变分类过程中,因为数据集不均衡、类间特征相似、类内又存有差异,从

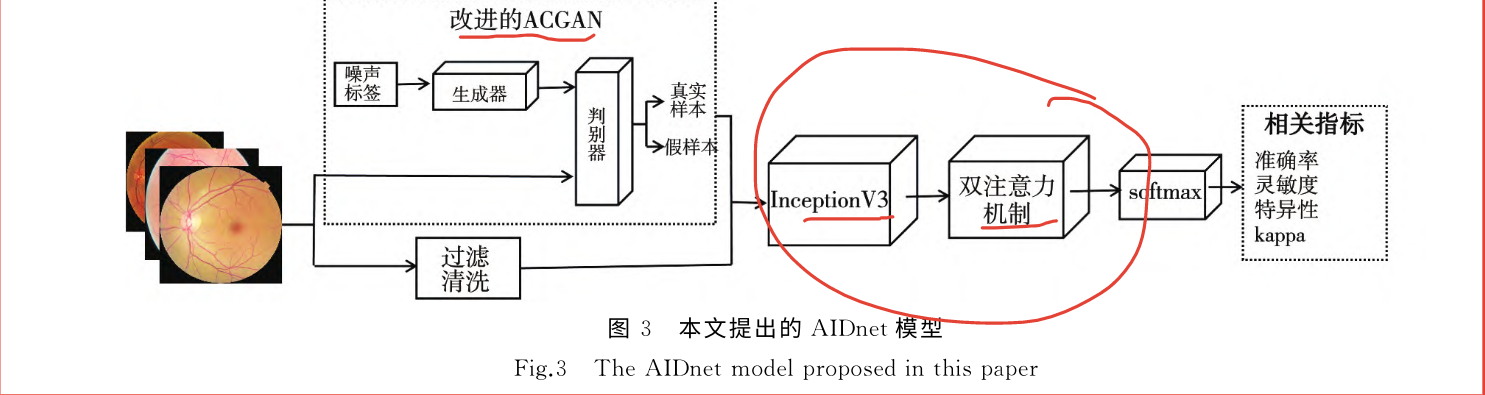

而导致最终分类准确率不高的问题,提出了一种****结合生成对抗网络与双注意力的分类方法 AIDnet。首先,

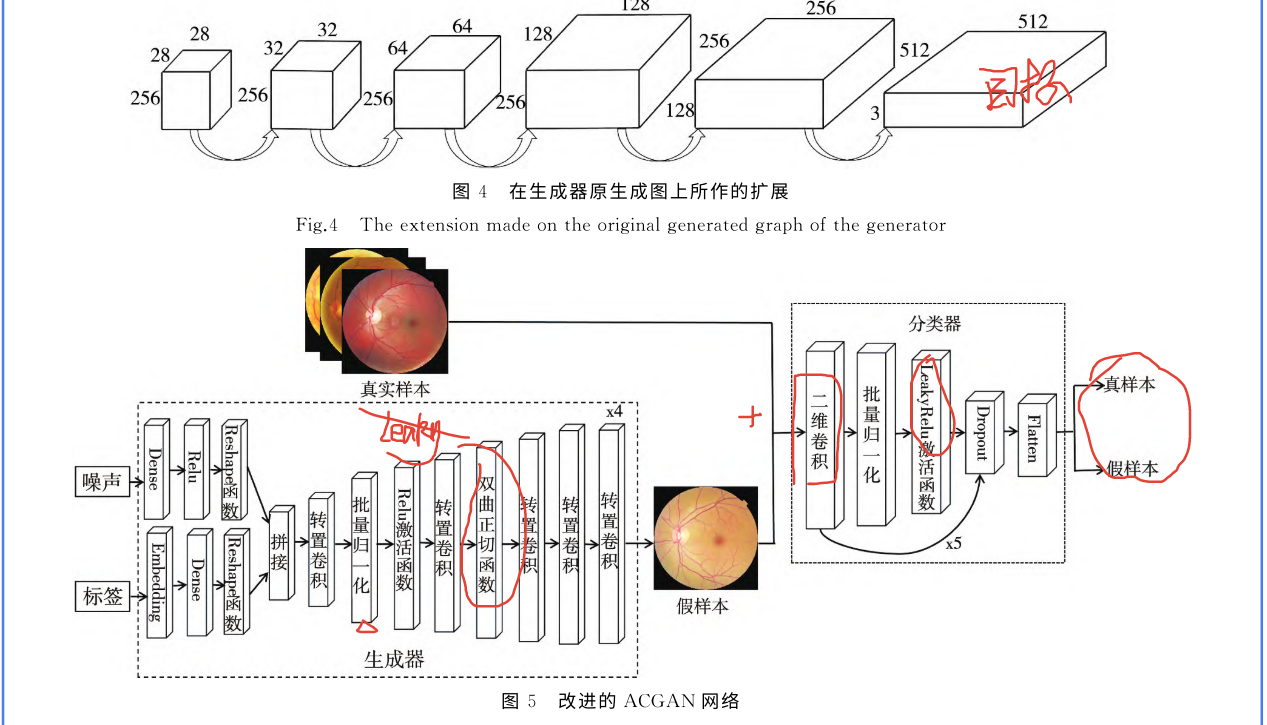

在ACGAN网络后加入转置卷积进行改进,生成轻度NPDR、重度NPDR、PDR的图像平衡数据集;

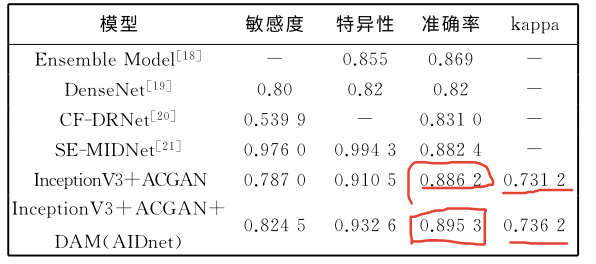

其次,在inceptionV3网络的基础上加入双注意力机制(DAM),减少易识别病变权重,高效的提取DR图像细节特征,AIDnet网络在kaggle数据集上的自动分类准确率为89.53%,敏感度为82.45%,特异性为93.26%;在Messidor2上的准确率达到90.31%,敏感度达到89.28%,特异性达到93.31%。较其他分类方法而言,AIDnet分类效果良好,有助于提高糖尿病视网膜病变的分类准确率

二、文章的复现前置知识

- ACGAN +GAN卷积神经网络模型

- 数据增强和数据预处理

- Attention + Double Attention

三、文章的结构

-

summary

-

introduction

-

介绍 diabetic retinopthy: DR病情背景, 具体强调了数据不平衡之间的问题。

-

介绍一下当下在diabetic retinopthy 上面的一些分类数据和他人的模型

-

分类数据集: kaggle, Messidor2, APTOS2019

-

Levenbery-Marquardt(LM)和贝叶斯正则化 : 67.74%

-

Inception-ResNet-V22上添加了自定义的卷积块,构建出了混合模型: 82.18%

-

Antery等提出了多尺度注意力网络 : 84.6%

-

-

提出自己方法: AIDnet+迁移学习, GAN生成样本

-

-

method

-

迁移学习:迁移学习是目前使用较多的样本数据增广方法(没有说明怎么迁移的)

-

生成对抗网络:提出GAN和ACGAN的概念

-

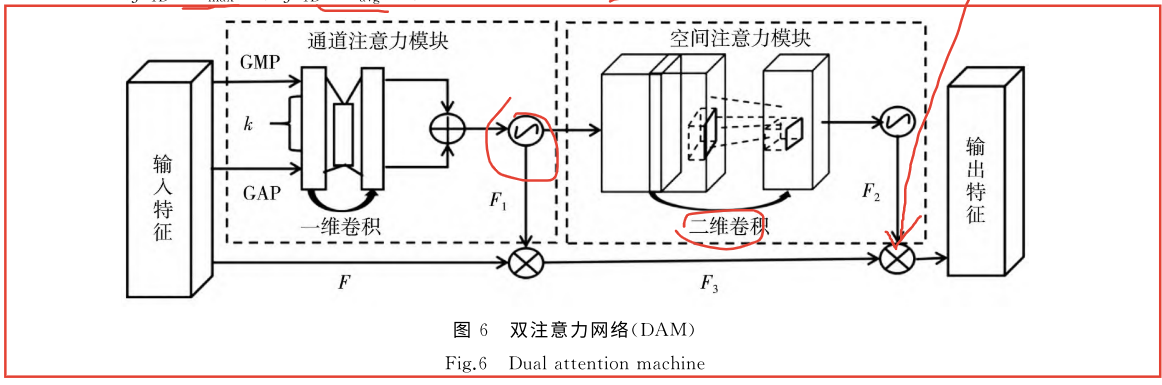

注意力机制:把Efficient输出特征 F 作为 Attention 的输入,提高细节注意度

-

Double Attention : 提出双注意力机制

-

-

model structure

- 提出总体模型设计

- 提出ACGAN的设计

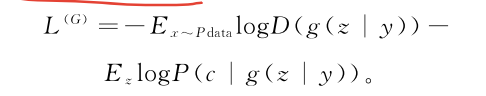

写出目标函数:

-

判别器的:

-

生成器的

-

提出Double Attention 设计

-

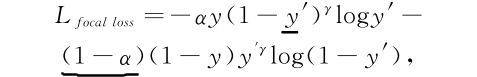

损失函数focal loss

补充:focal loss可以自适应地改变难分类的样本和

易分类样本在损失函数里的权重,解决严重的样

本不平衡问题,而且不需要计算复杂的权值映射,

使模型能够更好地捕捉图像特征。

-

数据集选择

- Messidor-2

- kaggle Eye-PACS

-

数据预处理

- 数据增强: 两个数据集中健康的眼底图像数量远远多于

病变的眼底图像数量,在网络训练的过程中加入

数据增强的操作有助于在一定程度上减弱数据集

的不平衡,降低过拟合的风险。本文数据增强的

方法是:随机水平垂直翻转,按中心点随机旋转

90°,按照一定尺度和比率随机裁剪出512×512

的图片,增加明亮度与对比度

- 数据增强: 两个数据集中健康的眼底图像数量远远多于

-

ACGAN迁移训练和数据的生成

训练ACGAN模型,在imageNet上面进行训练的inceptionV3 进行测试,保存好的模型,然后去生成数据集里面比较少的数据。(这里经过人工筛选之后得到比较好的数据)。这里在imageNet上面使用的inceptionV3的优化器是Adam,训练次数4000

-

训练开始

-

lr = 0.01

-

SGD优化器 weight-decay = 1e-4, momentum = 0.9

-

焦点损失函数和交叉熵损失函数

-

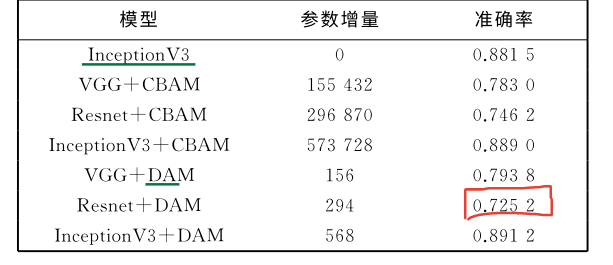

DAM + inceptionV3 或者 CABM

-

-

实验结果分析

-

Tab2 Comparision of parameters and accuracy results after adding attention model

-

Comparision of classification results on Kaggle

-

comparision of classification results on Messidor-2

-

-

-

结论

四、总结

-

文章优点

- 文章结构清晰, 提出问题,引出自己的论点,然后提出总体设计,分开讲解每一个模块的设计,非常清晰。

- 换了一个角度去进行数据增强,值得借鉴(这里可以换成扩散网络试试看)

- Double Attention 使用

-

文章缺点

- 没有吧,没看出来,就是对别人模型的复现有点差

-

借鉴之处

- 换了一个角度去进行数据增强,值得借鉴(这里可以换成扩散网络试试看)可以使用感觉。

- Double Attention

五、复现

文章具有可复现的可能,数据集+模型结构,没有预训练数据集,然后还需要学习一下GAN和ACGAN。